الاتصالات

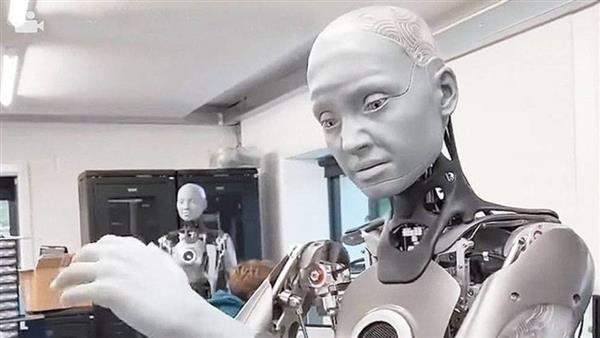

كيف يمكن للذكاء الاصطناعي أن يتلاعب بالبشر؟

By amrمايو 12, 2024, 16:57 مالتعليقات على كيف يمكن للذكاء الاصطناعي أن يتلاعب بالبشر؟ مغلقة

السابقالصين تطلق قمرا اصطناعيا جديدا لرصد البيئة الفضائية

التاليعاصفة مغناطيسية تضرب الأرض خلال أيام